شرکتهای تکنولوژی سالهاست با مشکلات زیادی مواجهند و هیچ الگوریتم سادهای برای تشخیص محتوای تولیدی انسان با هوش مصنوعی وجود ندارد. از سوی دیگر، شرکتهای فناورانه با حذف محتواهای مشکوک یا هر ممنوعیتی، کار را برای انسان سختتر میکنند.

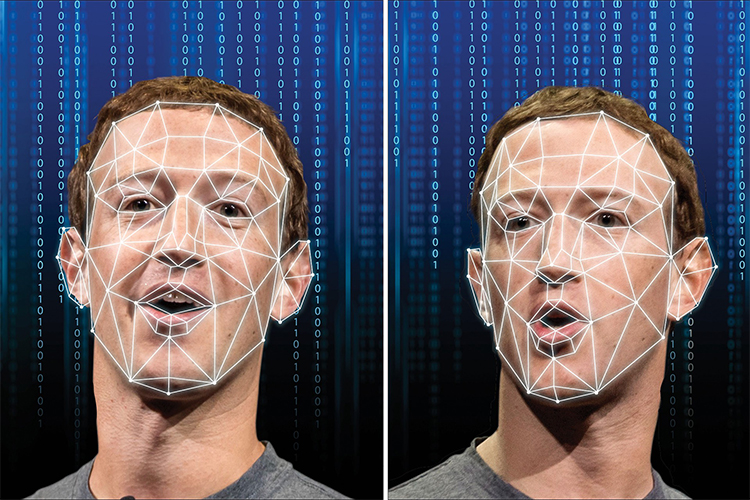

تابستان سال گذشته ویدئویی از مارک زاکربرگ منتشر شد. مدیرعامل فیسبوک و اینستاگرام در این ویدئو درباره فناوریهای تازه اظهار نگرانی کرد. به گفته مارک زاکربرگ، کنترل میلیاردها انسانی که دادهها را میدزدند، کار دشواری است.

براساس یافتههای شرکت فیسبوک، این کمپانی و دیگر شرکتهای قدرتمند تکنولوژی، سیاستگذاری مناسبی برای حرکات خشونتآمیز یا دزدیهای اینترنتی ندارند. این بررسیها نشان میدهد شرکتهای فناوری بزرگ آمادگی لازم برای مقابله با حمله رسانههای جعلی را ندارند.

رسانههای جعلی که آن را به نام دیپفیک(deepfakes) میشناسند، آسیب زیادی به پلتفرمهای تکنولوژی میزند. نکته قابل تامل درباره دیپ فیکها این است که در پلتفرمها نفوذ میکنند و این مسئله تنها در خصوص فیسبوک صدق نمیکند. دیپفیکها به طرز عجیبی کنترلناپذیرند.

متعادلسازی دشوار دیپفیکها، نهتنها به دلیل دشواری تشخیص آنها بلکه به دلیل گستردگیشان است. دیپفیکها هر محتوایی را تحت تاثیر قرار میدهند. آنها به عکسها، تصاویر ویرایششده و ویدئوها آسیب میزنند.

ممنوعیت دیپفیک نیز مشکلاتی را به همراه دارد. چراکه ممنوعیت دیپفیک به معنای حذف جوکهای محبوب مردمی، سلفیهای اسنپچت و تصاویر چهرههای مصنوعی است. منع سیاستهای گمراهکننده نیز به جای کاهش مشکلات سیاسی، آن را افزایش میدهد.

شرکتهای تکنولوژی سالهاست با مشکلات زیادی مواجهند و هیچ الگوریتم سادهای برای تشخیص محتوای تولیدی انسان با هوش مصنوعی وجود ندارد. از سوی دیگر، شرکتهای فناورانه با حذف محتواهای مشکوک یا هر ممنوعیتی، کار را برای انسان سختتر میکنند. شرکتهایی مانند فیسبوک، با توجه به تعداد کاربرانشان با مشکلات بیشتری روبهرو میشوند.

تیم هوانگ (Tim Hwang)، مدیر سابق مجله اخلاق و حاکمیت موسسه هوش مصنوعی در امآیتی (Harvard-MIT)، به مجله خبری ورج (The Verge) میگوید: «اگر شما دیپفیک را به معنی هر ویدئو، تصویر یا محتوایی بدانید که توسط ماشین لرنینگ ادیت شده است، با حجم عظیمی از مجموعهها مواجه میشوید. با این روش همه چیز در یک فرایند عدم قطعیت قرار میگیرد. دیپفیکها معضل بزرگی برای مرتبکردن رسانههاست.»

[bs-quote quote=”در سالهای اخیر دیپفیک مترادف با اطلاعات نادرست سیاسی بود، اما تعریف واقعی دیپفیک بسیار گستردهتر است. پیشبینی میشود معضل محتوای جعلی در سال ۲۰۲۰ بدتر شود” style=”default” align=”left” color=”#1e73be”][/bs-quote]

به نظر میرسد پلتفرمهای بزرگی چون فیسبوک و ردیت در هفتههای گذشته سیاستهایی را برای متعادلسازی دیپفیکها اتخاذ کردهاند. این دو شرکت به جای آنکه تمام فرمتها را در نظر بگیرند، محدوده کمتری را درنظر گرفتهاند.

فیسبوک ادعا میکند با حذف رسانههای گمراهکننده از هوش مصنوعی یا یادگیری ماشین استفاده میکند. با این روشها و راهحلهایی که هنوز دربارهاش صحبتی نشده است، فیسبوک میتواند تا حدود زیادی دیپفیکها را تشخیص دهد.

شرکت ردیت(Reddit) درباره فرایند حذف رسانههای جعلی، اشارهای به هوش مصنوعی نکرده است. این شرکت از روشهای مستقل و انسانی به مسئله دیپفیکها میپردازد. به گفته مسئولان این شرکت، آنها همیشه زمینه هر محتوا را مد نظر قرار میدهند.

همانطور که بسیاری از شرکتهای فناوری اشاره کردهاند، سیاستهای مربوط به دیپفیکها پر از نقاط ضعف هستند. ویل اورموس (Will Oremus) نویسنده تکنولوژی معتقد است رسانههای جعلی در فیسبوک در موارد سیاسی استفاده شدهاند. به عنوان مثال، سوزاندن پرچم آمریکا یا عکسهای تماس با سیاستمداران از موارد ثابتشده دیپفیک است.

بسیاری از گزارشها در سالهای اخیر دیپفیک را مترادف با اطلاعات نادرست سیاسی میدانند، اما تعریف واقعی دیپفیک بسیار گستردهتر است؛ همانطور که مشکلاتی که دیپفیک به وجود میآورد. محققان حوزه فناوری اطلاعات پیشبینی میکنند معضلات مرتبط با محتواهای جعلی در سال ۲۰۲۰ بدتر خواهد شد.

در حالی که نسخههای قبلی نرمافزار دیپفیک به کمی صبر و مهارت تکنیکی برای استفاده نیاز داشتند، نسل بعدی برنامههای دیپفیک سادهتر ساخته و ارسال خواهند شد.

برنامههای کاربردی که از هوش مصنوعی برای ویرایش ویدئو استفاده میکنند، در سال ۲۰۲۰ متداول خواهند شد.

همینطور برنامههای زیادی برای طنزپردازی، توییتهای مرتبط با نشان تجاری، قلدری و آزار در فضای مجازی با توجه به دیپفیکها ساخته شده است. ایده دیپفیک به عنوان یک تهدید، حقیقت را در فضای آنلاین محو خواهد کرد.